作为AI大模型领头羊公司的OpenAI在今年春节前后发布了视频生成大模型Sora,以其优越性能震惊了全世界,然而它几乎也同时向外界"Close"了Sora的技术大门。就此国内开启了新一轮讨论,中国在人工智能领域是不是落后得越来越远了?

面对各界纷纷议论,近日,北京大学深圳研究生院-兔展智能AIGC联合实验室在深圳正式推出Open-Sora计划,旨在复现开源版的Sora。这一计划根植于北京大学和兔展智能长期以来的技术沉淀,证明了中国产业龙头公司和顶尖科研机构合作,有能力也有条件在AI领域内一较高下。

“我们一直以开放姿态拥抱人工智能的未来,世界需要多一种选择,不可能只有一个Sora,我们需要有另一种选择,一个全球普惠的AI。”兔展智能创始人、CEO董少灵表示,兔展智能和北大团队也希望通过开源的方式,带动全球范围感兴趣的技术人员参与和贡献进来,同时对外传播中国团队的技术自信,号召全球社区一起来做人类普惠的内容,为市场带来更多选择。

北大信息工程学院助理教授、博导袁粒介绍,Open-Sora计划已于近期在GitHub上公开,它核心技术框架包括视频编解码模块、Diffusion Transformer模型和条件输入三大模块。与“财大气粗”的OpenAI不同,在资源有限的情况下,Open-Sora计划采用了计算更友好的2D + 1D Diffusion Transformer,同步还在推进除了文本控制外的更多条件控制的视频生成训练。

目前基于已经搭好的训练框架,能够支持动态输入、多尺度、多分辨率的训练,对于可变比例、可变时长的视频已经取得了较好的生成效果,初步完成了第一阶段验证的任务。第二阶段将在有效框架基础上使用更多数据和更大算力,训练出20秒以上、720P清晰度的视频生成模型,实现该开源项目的目标;第三阶段作为延展目标,如果得到更多支持的情况下,会考虑进一步延伸拓展生成的泛化性,场景多样性等,更加逼近Sora的时长和效果,目前仅作为本项目的拓展目标。

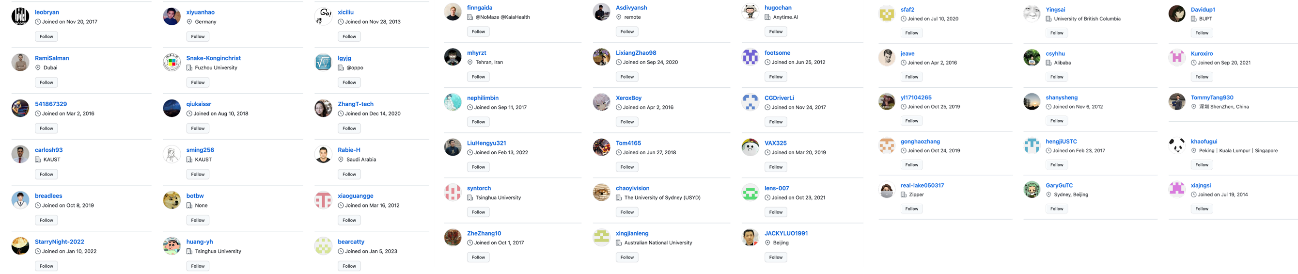

袁粒介绍,该项目在GitHub上一经发布,就引起了国际人工智能大V的纷纷转发,该帖子浏览量破20万,国内外网友纷纷表示期待。发布一周内Star超过5K (5000多名技术开发人员标星),登上GitHub Trend第一,在开源社区拥有很高的参与度和活跃度,一周内融合30余次开源创作者的拉取请求(Pull Request),一周内更新模型和代码两百余次,获得14万余次访问,代码被克隆超800次,更有来自美国、英国、加拿大、德国、澳大利亚、迪拜、沙特阿拉伯、伊朗等多个国家的技术人员参与其中,做出积极贡献。

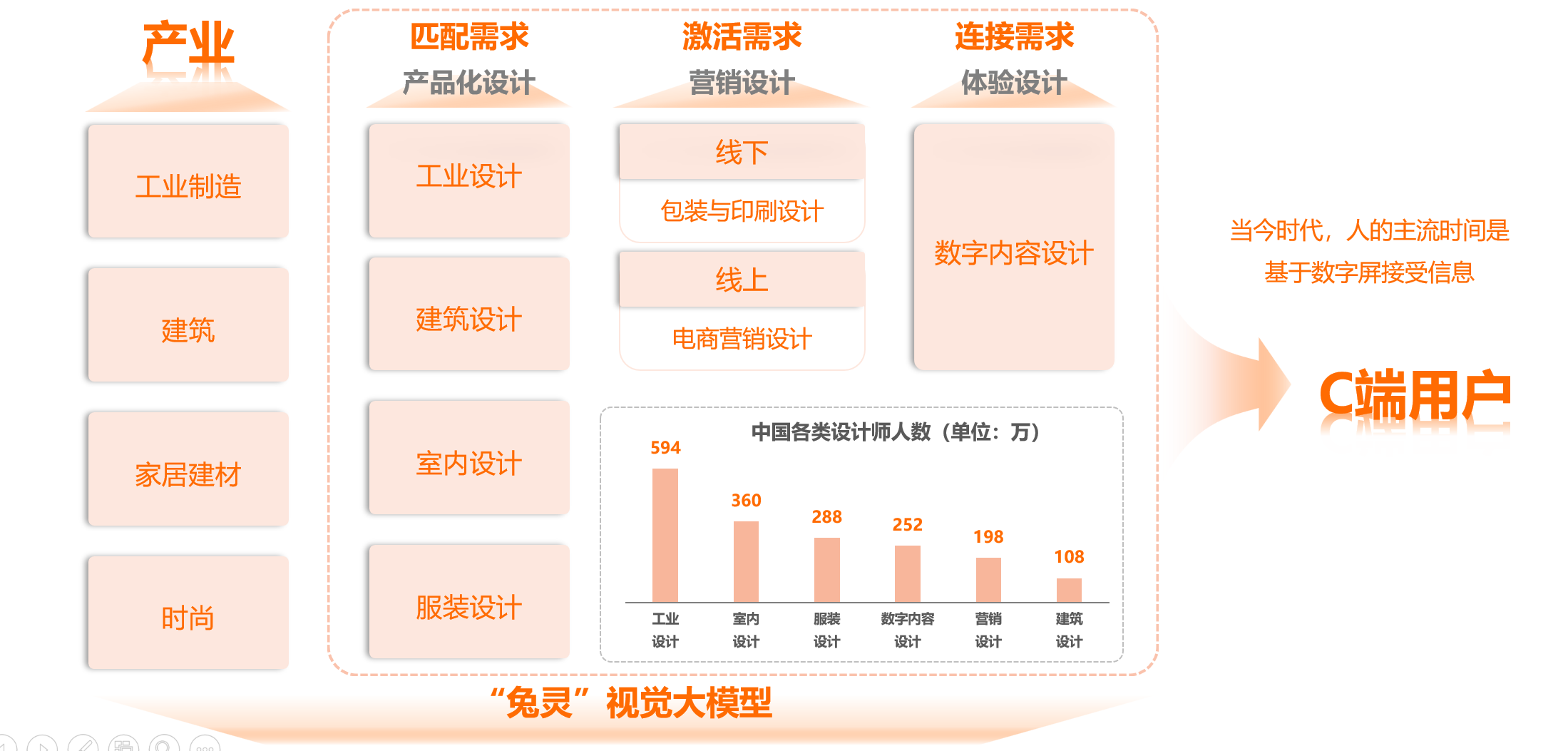

“对于兔展智能来说,Open-Sora并不是为了做娱乐视频生成而提出的,将Open-Sora背后的底层模型,亦即‘兔灵’,打造成深植于产业、赋能产业发展的中国本土的视觉大模型,让产业的供给与用户的需求更精准的匹配,才是更有价值的事情。”作为Open-Sora计划的联合发起方之一,兔展智能也为项目带来了产业界的思考,董少灵介绍,兔展智能是中国在内容引擎技术领域完全自主创新的行业龙头企业,在“让人类叙事更加高效生动”的使命指引下,围绕为社会带来崭新的智能交互形态的期待,兔展智能推出了基于视觉为核心的原创多模态大模型“兔灵”的AIGC内容引擎。

兔展智能经过多年深耕,依托借庞大的用户量和数据飞轮,重度投入打磨“兔灵”大模型,希望通过“人工智能+”将以设计行业为代表的产业界过剩的产能,通过产品化设计更个性化的产品匹配需求,通过营销设计来激活需求,通过体验设计来连接需求,生成触达每一个终端个人的智慧屏内容,最终实现供给和需求更精准的匹配。

记者了解到,Open-Sora的诞生也离不开由兔展智能和北京大学共同探索的“TOP + TOP”科研与产业深度共赢的科创新范式。在学习吸纳美国先进研究机构科研创新机制的基础上,兔展智能联合北京大学深圳研究生院于2023年共同成立了AIGC联合实验室,提出了坚持“人类级使命”、“奋斗者为本”、“开放式创新”、“真问题驱动”四大原则,共同探索产学研协同创新发展的新路径。未来,双方也将在推动视觉大模型更好赋能中国产业发展继续携手并进,为世界带来更多中国声音。

编辑 冯思颖 审读 吴剑林 二审 桂桐 三审 张雪松