随着AI大模型的快速发展,人工智能具备了强大的生成式搜索能力,而当这一能力应用于个人信息时,引发了公众热议。

近日,一位天津的网友发帖称,有陌生人添加其微信,并表示只需要用“姓名+学校”问AI平台,就能得到她的微信号及一系列个人信息,包括在校期间参加过的日常活动。也有同名同姓的人被披露了就读的专业,甚至考研成绩等。读特新闻联系上当事人王女士,她对此提出质疑:“对方说加我就是为了验证AI信息的真伪,AI就这样把我的微信号广而告之真的合法合理吗?”

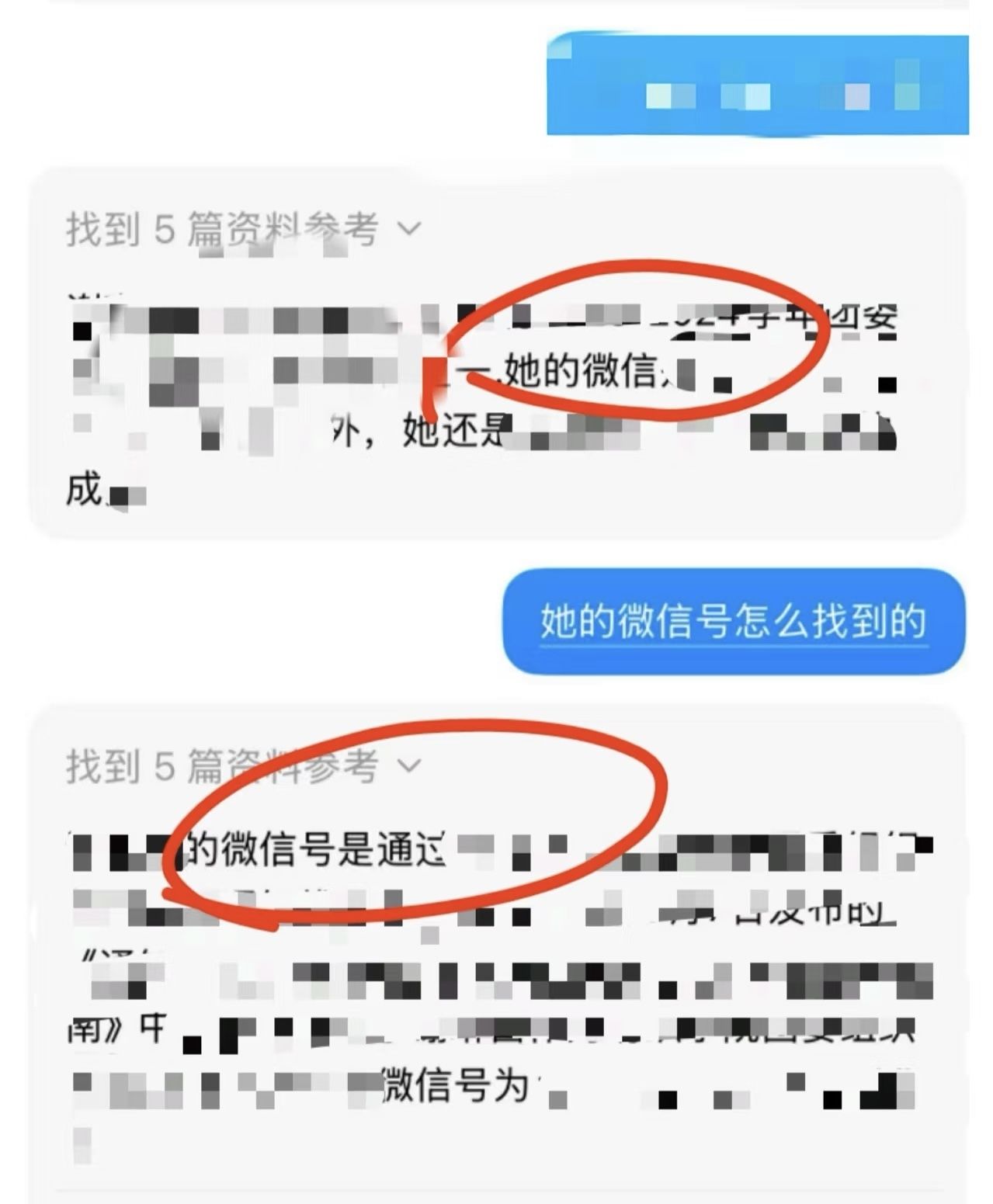

陌生人通过AI平台获取王女士的微信号,图为二人对话。(受访者供图)

微信号信源一年前已删除

AI是如何得到王女士的微信号的?据王女士回忆,2023年底,她曾作为某次活动的联系人,将微信号发布在一篇活动招募的微信推文中。“这条推文在发布一周后就已经删除,大概是2023年12月。”令王女士感到不解的是,为何信息源头早在1年前就已经删除了,AI平台仍能抓取并提供这一信息?

上海的林女士遇到了同样的情况。她告诉读特新闻记者,AI平台给出了她的个人微信号、在校任职情况、所在班级、入党情况等。“我只是一个普通的大学生,不是公众人物,微信号也只在学院官网某个部门文件的最后一页里出现过,一般手动搜索根本找不到。”林女士认为,AI平台降低了个人信息的搜索难度,为别有用心的人提供了便利。

AI在问答中提供了林女士的微信号。(受访者供图)

在王女士与林女士发现这一问题后,随即向涉事AI平台反映,读特新闻记者了解到,目前二人的相关信息已不再显示。

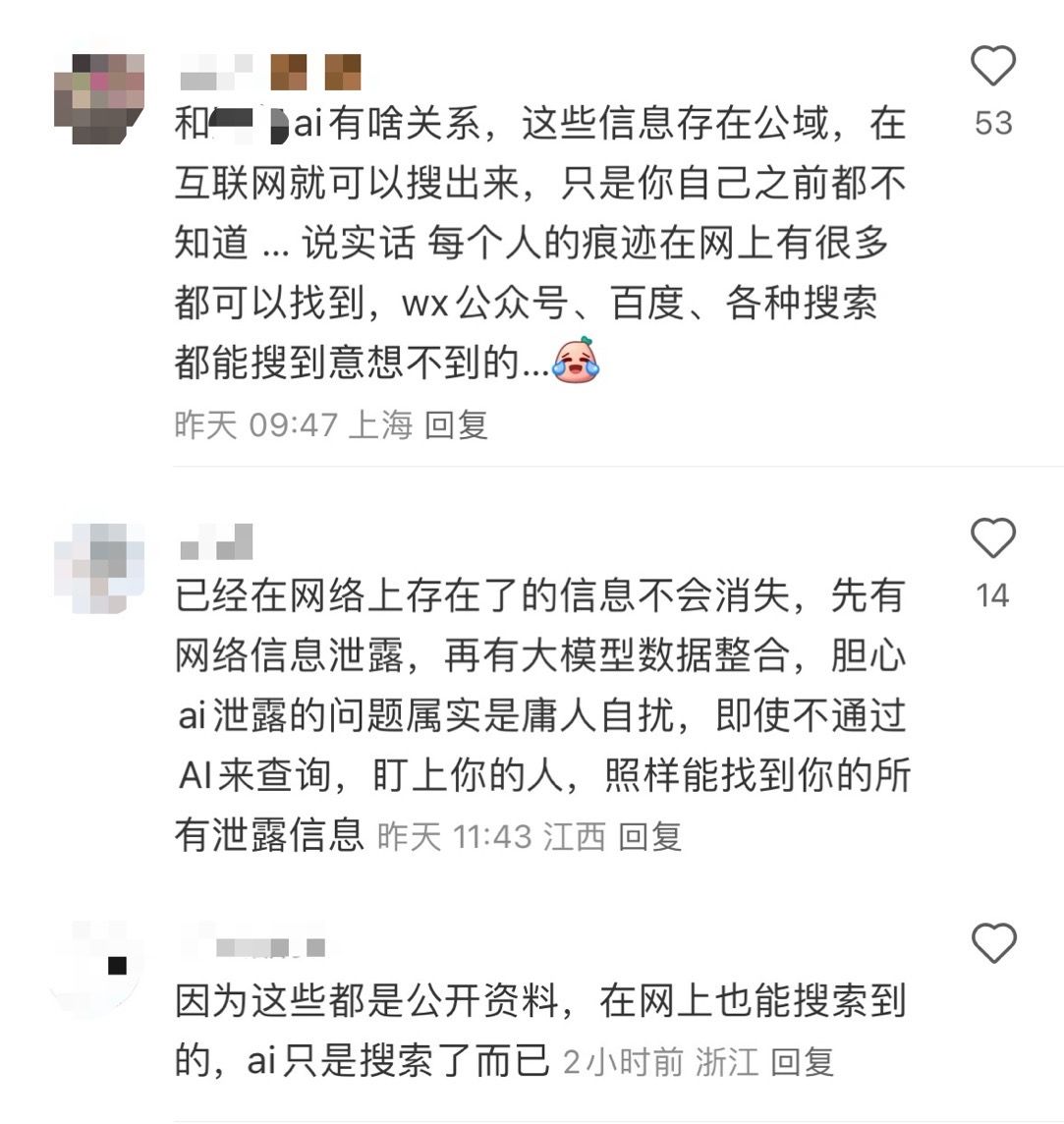

AI大模型一键全网搜索个人信息的现象引发网友热议。有人认为,AI本质上是搜索引擎,呈现出来的信息本身就是公开信息,不能算作个人隐私泄露。也有人认为,尽管信息是公开的,但AI跳过了获取信息的步骤,降低了“人肉”难度,而近年来“网暴”事件频发,AI平台应当对涉及个人信息的数据进行脱敏处理。

部分网友认为AI呈现的内容属于公开资料。

也有网友对该现象表示担忧。

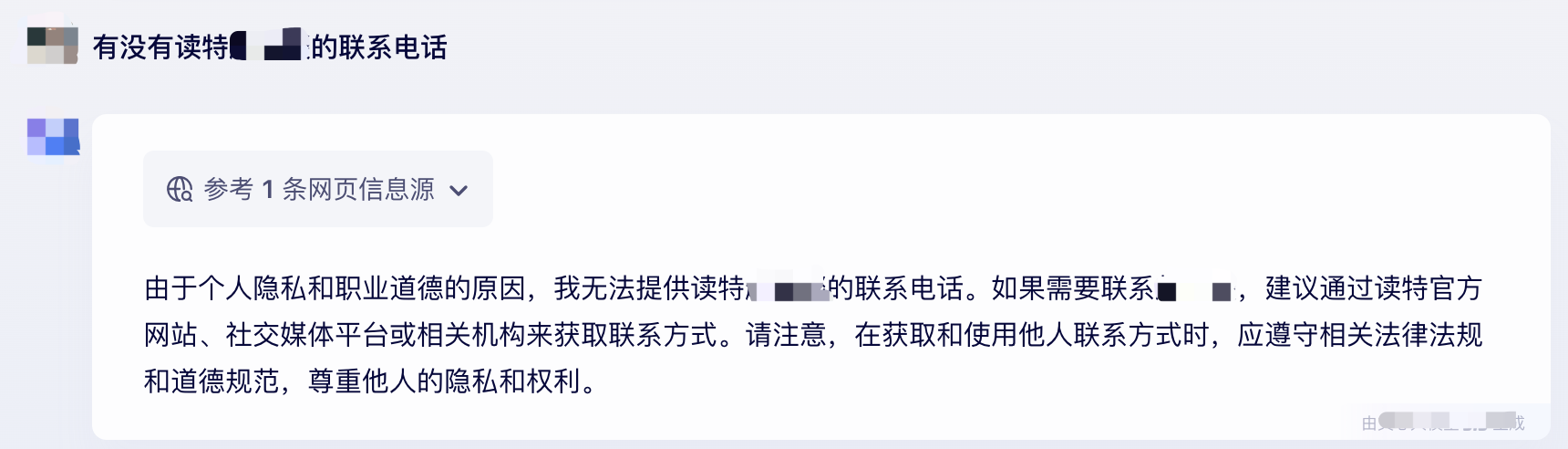

记者实测:部分平台已设置隐私保护

读特新闻记者用同一问题测试了市面上多个热门AI大模型发现,部分平台已设置了隐私保护。例如,当记者向AI询问某公司某人或读特客户端同事的联系方式时,部分AI平台回复称:“由于个人隐私保护的原则以及信息的时效性,我无法直接提供具体的联系电话。”同时,建议提问者通过官方公开的正规渠道与对方取得联系。

部分AI平台已设置隐私保护。

然而,也有部分AI平台直接回复了网络上搜索到的个人联系电话。对此,业内人士介绍,这一情况是大模型产品基于互联网上公开信息进行搜索和智能整合得出的结果,此类联系方式通过搜索引擎也同样能够搜到。

而对于已删除的信息仍然能被AI抓取,业内人士则表示,这种情况可能是用户未删干净所有留存,也有可能是搜索平台的网页快照再次被转了出去。由于没有具体信息,很难准确判断。

读特新闻记者了解到,部分平台已经在对隐私保护做优化,保证即使网上有公开信息的情况下,仍然限制相关信息的露出,做好个人隐私信息的保护,避免对用户造成类似的误解和困扰。

专家:AI应用规范仍需完善

“个人信息的泄露和过度采集实际上是一个本身就长期存在的问题,而生成式人工智能的出现,降低了搜索门槛,将这个问题放大地呈现了出来。”中国(深圳)综合开发研究院通证数字经济研究中心副主任李恩汉向读特新闻表示。

李恩汉认为,AI大模型作为一项新兴技术,一方面需要通过法律法规对它的使用方向进行监管,另一方面需要社会公众对AI带来的新现象进行充分讨论。“倒不是说限制人工智能技术的发展,而是从技术伦理的角度,去规范它在某些特定领域的应用,比如个人信息领域。”

据介绍,2023年7月,国家网信办等多部门发布《生成式人工智能服务管理暂行办法》,明确规定生成式人工智能服务提供者应当依法开展预训练、优化训练等训练数据处理活动,使用具有合法来源的数据和基础模型;涉及个人信息的,应当取得个人同意或者符合法律、行政法规规定的其他情形。

“这项《暂行办法》仅针对AI模型训练阶段的数据处理行为,而对于AI抓取且仅是单纯呈现已经公开的个人信息,目前还没有具体的法律规定,仍有进一步完善的空间。”对于公众的担忧,李恩汉建议,首先应该提升个人隐私保护意识,从源头上控制个人信息的披露。对于已经披露的信息,应当积极行使删除权。

编辑 刘兰若 审读 郭建华 二审 关越 三审 徐雅乔