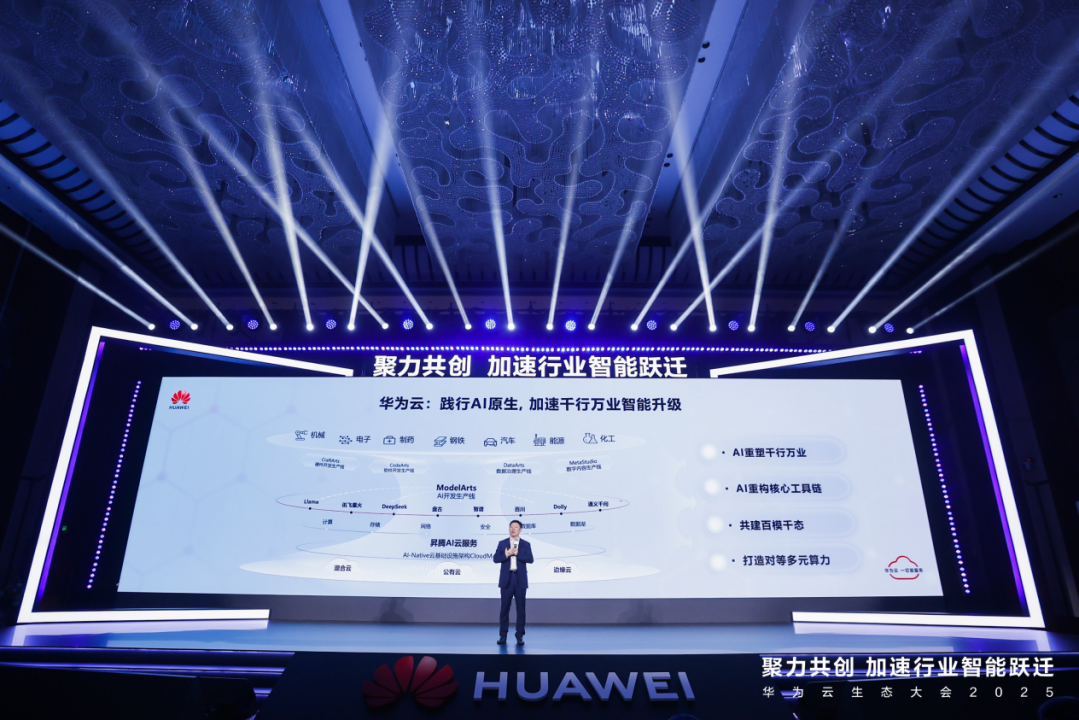

6月20日,在华为开发者大会2025(HDC 2025)上,华为常务董事、华为云计算 CEO张平安宣布基于CloudMatrix384超节点的新一代昇腾AI云服务全面上线,其能为大模型应用提供澎湃算力。

据了解,随着大模型训练和推理对算力需求的爆炸式增长,传统计算架构已难以支撑AI技术的代际跃迁。而华为云新一代昇腾AI云服务,基于CloudMatrix384超节点集群,能达到单集群300 PFlops(PFlops:每秒一千万亿次浮点运算),能效比达到行业先进水平。其首创将384颗昇腾NPU和192颗鲲鹏CPU通过全新高速网络全对等互联,形成一台超级“AI服务器”,单卡推理吞吐量跃升到2300 Tokens/s。而超节点架构可以实现“一卡一专家”,一个超节点可以支持384个专家并行推理,极大提升效率。同时,超节点还可以支持“一卡一算力任务”,灵活分配资源,提升任务并行处理,减少等待,将算力有效使用率提升50%以上。

对于万亿、十万亿参数的大模型训练任务,在云数据中心,还能将432个超节点级联成最高16万卡的超大集群;同时,超节点还可以支持训推算力一体部署,如“日推夜训”,训推算力可灵活分配,帮助客户资源使用最优。

张平安表示,昇腾AI云服务得到了全球客户、伙伴和开发者的支持。新浪与华为云深度合作,基于CloudMatrix384昇腾AI云服务,为“智慧小浪”智能服务体系构建了统一的推理平台,底层由昇腾AI算力提供支持。推理的交付效率提升了超过 50%,模型上线速度成倍加快;通过软硬协同调优,NPU利用率提升超过40%,每一份资源都得到更高效的使用。

硅基流动正在使用CloudMatrix384超节点,为数百万用户高效提供DeepSeek V3、R1的推理服务。面壁智能使用CloudMatrix384超节点,让他们的小钢炮模型的推理业务性能得到了2.7倍提升。

在科研领域,中国科学院基于CloudMatrix384超节点打造了自己的模型训练框架,快速构建了中国科学院AI for Science科研大模型,摆脱了对国外高性能AI算力平台的依赖。

在互联网领域,360打造的纳米AI搜索,为用户提供超级AI搜索服务,对AI算力有极大需求,也已开启了CloudMatrix384超节点的测试。

当前,昇腾AI云服务已经成为AI基础设施的最优选择,为超过1300家客户提供澎湃的AI算力,加速千行万业智能化升级。

编辑 刘彦 审读 吴剑林 二审 杨渝嘉 三审 上官文复